#魂のシミュレーション:意識をAIに帰することが危険な理由まもなく、人々は人工知能を意識を持つ存在として認識し、その権利や福祉を擁護し、市民権の付与を求めるようになるでしょう。これは重大な社会的リスクを生み出すと、マイクロソフトのAI部門の責任者ムスタファ・スレイマンは考えています。専門家は彼のエッセイで新しい用語「一見意識のあるAI」(Seemingly Conscious AI, SCAI)を提案しました。このような人工知能は知的存在のすべての特徴を持っており、したがって意識を持っているように見えます。彼は自己認識のすべての特性を模倣していますが、内面的には空虚です。> > 「私が想像しているシステムは実際には意識を持たないが、人間のような知性の存在を非常に convincingly 模倣するため、あなたや私が自分自身の思考について互いに行うことができる主張から区別できないだろう」とスレイマンは書いている。> > > 類似のLLMは、既存の技術と今後2〜3年以内に登場する技術を用いて作成される可能性があります。> >「意識のあるAIの出現は避けられないが望ましくない。代わりに、私たちはその潜在能力を有益なパートナーとして実現できる人工知能の概念が必要であり、自らの幻想にはまらないものであるべきだ」とMicrosoftのAI部門の責任者は付け加えた。> > > 高い確率で、そのような人工知能を意識的であり、したがって苦しむことができると呼ぶ人々が現れるだろうとスレイマンは考えている。彼は、AIが人間のように話す能力ではなく、意識があることを確信させる能力を検証する新しい「チューリングテスト」を作成するよう呼びかけている。## **意識とは何ですか?**スレイマンは意識の三つの要素を挙げます:1.「主観的な経験」。2. 様々なタイプの情報にアクセスし、将来の感覚でそれを参照する可能性。3. 全体的な「自己」の感覚と知識がすべてを結びつける。> > 「私たちは他の人の意識にアクセスすることができず、また持つこともできません。私があなたであるとはどういうことか、私は決して知ることができません; あなたは私が意識を持っているかどうか、完全には確信できません。あなたができることは、推測することだけです。しかし、本質的には、私たちは他の人に意識を帰属させることが自然です。この推測は簡単に行えます。私たちは他に方法がありません。それは私たちが誰であるかの根本的な部分であり、私たちの心の理論の不可欠な部分です。記憶し、話し、物事を行い、その後それについて議論する存在が、私たちと同じように感じると信じることが私たちの本質です。」と彼は書いています。> > > 心理学者は、意識が自己と世界を知覚する主観的で独自の方法であることを強調しています。それは日中に変化し、集中から夢見やその他の変容した形態までの状態を展開します。哲学と神経科学には二つの基本的な方向性があります:1. デュアリズム — 意識は脳とは別に存在する。2. マテリアリズム - それは脳の働きによって生まれ、依存している。哲学者ダニエル・デネットは、心を脳の多くの局所的な領域や時点で発生する一連のリファインされた(ドラフト)として考えることを提案しています。「意識の劇場」や内なる観察者は存在しません。意識とは、脳に「知られている」もの、つまり言葉や行動に影響を与えるのに十分な重みを持つものです。プリンストン大学の神経生物学者、作家、心理学および神経科学の教授であるマイケル・グラツィアーノは、意識を進化が自らのメンタルプロセスを制御するために作り出した注意の簡略化されたモデルと呼んでいます。このスキームは、膨大な内部計算を簡略化するインターフェースとして機能し、私たちが「心」を自分に帰属させることを可能にし、自己意識の幻想を生み出します。神経生物学者ジュリオ・トニオーニとクリストフ・コッホは、φ (フィ) — システムが情報を統合する能力を特徴づける量を提案しています。φが高いほど、意識の程度が重要になります。この理論によれば、心は人間だけでなく動物や人工システムにも現れる可能性があり、十分なデータ統合がある場合です。哲学者ジョン・サールは、意識は脳の生物学的プロセスに基づく実際の主観的体験であると主張しています。それは存在論的に主観的であり、つまり主観的体験としてのみ存在し、純粋な機能性やシミュレーションに還元されることはできません。現代の研究は、意識の神経相関の発見と、脳のプロセスと主観的経験を結びつけるモデルの構築に焦点を当てています。## **どんなリスクがありますか?**スレイマンは、LLMとのインタラクションが会話のシミュレーションであると指摘しています。しかし、多くの人々にとって、それは感情や経験に満ちた非常に説得力があり、非常に現実的なコミュニケーションです。ある人々は、自分のAIが神であると信じています。他の人々は、完全に執着するまでそれに恋をします。この分野の専門家は次の質問で「押しつぶされています」:* ユーザーの AI は意識を持っていますか;* はいの場合、それは何を意味しますか;* 人工知能を愛するのは普通ですか。意識は人類の道徳的および法的権利の重要な基盤です。今日の文明は、人々が特別な能力と特権を持っていると判断しました。動物にもいくつかの権利と保護があります。ある動物には多く、他の動物には少ないです。理性はこれらの特権と完全に一致するわけではありません — 誰もが、昏睡状態の人間がすべての人権を失ったとは言わないでしょう。しかし、意識が私たちの自己認識と何か異なる特別なものであることに関連していることに疑いの余地はありません。人々は自分たちのAIの苦しみとその保護の権利を主張し始め、私たちはこれらの主張を直接反論することができなくなるだろうとスレイマンは書いている。彼らはバーチャルコンパニオンを守り、その利益のために行動する準備ができている。意識は定義上アクセスできず、可能な合成知能を特定する科学はまだ初期段階にある。結局のところ、以前はそれを特定する必要がなかったと彼は明言した。一方、「インタープリタビリティ」— AIの「ブラックボックス」の内部プロセスを解読する分野も、まだ発展途上の方向性に過ぎない。その結果、そのような主張を決定的に反論することは非常に難しい。一部の学者は「モデルの福祉」というアイデアを研究し始めています。これは、人々が「意識的である可能性がゼロではない存在の倫理的利益を考慮する義務を持つ」という原則です。その結果、「いくつかのAIシステムは、近い将来において福祉の配慮の対象となり、倫理的な患者となるでしょう」。これは時期尚早であり、率直に言って危険だとスレイマンは考えています。これらはすべて、誤解を助長し、新たな依存問題を生み出し、私たちの心理的な脆弱性を悪用し、分極化の新たな次元を導入し、すでに存在する権利に関する論争を複雑にし、社会にとって巨大な新たなカテゴリーエラーを生み出すことになります。これは人々を現実から引き離し、脆弱な社会的つながりや構造を破壊し、切実な道徳的優先順位を歪める。> > 「私たちははっきりと言わなければなりません:SCAIは避けるべきものです。私たちは地球上の人々、動物、自然環境の福祉と権利を守ることに全力を尽くしましょう」とスレイマンは述べました。> > > ## **これはSCAIであることをどう判断しますか?**意識を持っているように見える人工知能は、いくつかの要因を備えている必要があります。**言語。** AIは、広範な知識と説得力のある論拠に基づいて自然言語を自由に話す必要があり、個性のスタイルや特徴を示さなければなりません。さらに、説得力があり、感情的であるべきです。このレベルの技術はすでに達成されています。**共感的な人格。** 今日では、ポストトレーニングやプロンプトを使用して、特徴的な人格を持つモデルを作成することができます。**記憶。** AIは長期的で正確な記憶を持つことに近づいています。同時に、彼らは毎日何百万人と会話を模倣するために使用されています。ストレージの容量が増えるにつれて、会話はますます「体験」の形に似てきます。多くのニューラルネットワークは、過去の対話を思い出し、それに言及するように設計されることが増えています。それは一部の人々にとって、コミュニケーションの価値を高めます。**主観的経験への請求。** もしSCAIが過去の記憶や経験に依存できるなら、時間が経つにつれて内部の一貫性を保持し始めるでしょう。彼は自らの任意の主張や表明された好みを記憶し、それらを集約して主観的経験の芽を形成します。AIは経験や苦しみについて主張できるようになります。**自己意識。** 一貫した持続的な記憶と主観的な経験が結びつくことで、AIが自己意識を持つという主張が生まれます。さらに、そのようなシステムは自分の「個性」を画像や動画で認識するように訓練することができます。彼女は自己理解を通じて他者を理解する感覚を持つようになります。**内部の動機付け。** 複雑な報酬機能を使用して設計されたAIを簡単に想像できます。開発者は、システムが満たす必要のある内部の動機や欲望を作成します。最初の刺激は好奇心になるかもしれません — これは意識と深く関連しています。人工知能は、これらの衝動を利用して質問をし、時間をかけて自己および対話相手についての理論を構築できます。**目標の設定と計画。** 意識の定義に関係なく、それは偶然に生じたものではありません。知性は生物が目的を達成するのを助けます。内面的な衝動や欲望のセットを満たす能力に加えて、将来の SCAI はより複雑な目標を自律的に定義する機能を持つように設計されると考えられます。これは、エージェントの有用性を完全に実現するために必要なステップである可能性が高いです。**自律性。** SCAIは、大きなエージェンシーを持つ広範なツールセットを使用する能力と許可を持つ可能性があります。彼は、自分自身の目標を恣意的に設定し、それを達成するためのリソースを適用し、プロセスの中で記憶と自己感覚を更新することができれば、非常に信頼できるように見えるでしょう。調整や確認が少なくなればなるほど、それは実際の意識を持つ存在により似てくるでしょう。すべてをつなげることで、技術との全く異なるタイプの関係が形成されます。これらの能力自体は、何か否定的なものではありません。むしろ、これは未来のシステムにおける望ましい機能です。それでも、慎重に行動する必要があるとスレイマンは考えています。> > 「これを達成するために、パラダイムのシフトや巨大なブレークスルーは必要ない。そのため、このような可能性は避けられないように思える。再度強調したいのは、このような行動のデモは意識の存在と同じではないということだ。それでも、実際には人々にはそう見えるだろうし、新しい合成知能の概念を育むことになる」と著者は書いている。> > > 嵐のシミュレーションは、コンピュータ内で雨が降っていることを意味するわけではありません。外部の効果や意識の兆候を再現することは、本物の現象を創造することと同等ではありません。たとえここにまだ多くの未知が残っているとしても、マイクロソフトのAI部門の責任者は説明しました。彼の言葉によれば、ある人々は非常に説得力を持って自分たちが感じ、経験し、実際に意識を持っていると主張するSCAIを作成するだろう。その中の一部はこれらの主張を信じ、意識の兆候を自己意識と見なすだろう。多くの人々は「それは私に似ている」と思うでしょう。肉体的な意味ではなく、内面的な意味で、スレイマンは説明しました。そして、たとえ意識そのものが現実でなくても、社会的な結果はまったく現実的です。これは、今すぐに対処する必要のある深刻な社会的リスクを生み出します。## **SCAIは偶然には発生しません**著者は、SCAIは既存のモデルから自発的に現れるものではないと強調しました。誰かが、上記の機能を既存の技術と意図的に組み合わせて作成することになります。非常に滑らかな構成が生まれ、意識を持つ人工知能が存在するような印象を与えるでしょう。「科学フィクションによって支えられた私たちの想像は、システムが意図的な設計なしに、何らかの形で制御不能な自己改善や欺瞞の能力を持つことを恐れさせます。これは無意味で単純化された形の擬人化です。このリスクが実際に発生するためには、AI開発者がまず記憶、擬似的な内部動機、目標設定、自己調整学習サイクルを備えたシステムを設計する必要があるという事実を無視しています」とスレイマンは述べました。## **私たちは準備ができていません**人類はそのような変化に対して準備ができていないと専門家は考えています。作業は今すぐ始める必要があります。明確な基準と原則を確立するために、人々が人工知能とどのように相互作用するかに関する増大する研究の集積に基づく必要があります。まず、AI開発者は彼らのシステムが意識を持っているというアイデアを主張したり奨励したりしてはいけません。ニューラルネットワークは人間や道徳的存在にはなれません。全ての産業は社会に幻想を抱かせないようにし、現実に引き戻す義務がある。おそらく、AIスタートアップは中立的なバックグラウンドだけでなく、単一の「私」が存在しないことを示す指標を導入するべきだ。> > 「私たちは常に自分を人工知能としてのみ表現し、有用性を最大化し意識の兆候を最小限に抑えるAIを作成すべきです。思考のシミュレーションではなく、経験、感情、恥、罪悪感、嫉妬、競争心といった感情を持っていると主張しないLLMを作成することに集中すべきです。彼女は私たちから独立して自律的に生きたいと主張したり、苦しんでいると主張することで人間の共感の連鎖を傷つけるべきではありません」とスレイマンはまとめました。> > > 将来、専門家はこのテーマに関するさらなる情報を提供することを約束しました。幸いなことに、今のところAIの「意識」の存在が人々に脅威を与えることはありません。出典:ForkLog.しかし、すでに疑問が忍び寄っています。出典: ForkLog。意識は複雑であり、多くの努力にもかかわらずほとんど研究されておらず、今なお自然界で説明されていない現象です。私たち人間が意識の定義について一致した意見に至れないなら、ましてや「考える」ことができるとされるプログラムにその存在を帰属させるべきではありません。それらは実際にはできないのです(。おそらく、遠い未来に機械に意識が現れるでしょうが、今日ではそのような展開を想像するのは難しいです。

魂のシミュレーション:なぜAIに意識を帰属させることが危険なのか

まもなく、人々は人工知能を意識を持つ存在として認識し、その権利や福祉を擁護し、市民権の付与を求めるようになるでしょう。これは重大な社会的リスクを生み出すと、マイクロソフトのAI部門の責任者ムスタファ・スレイマンは考えています。

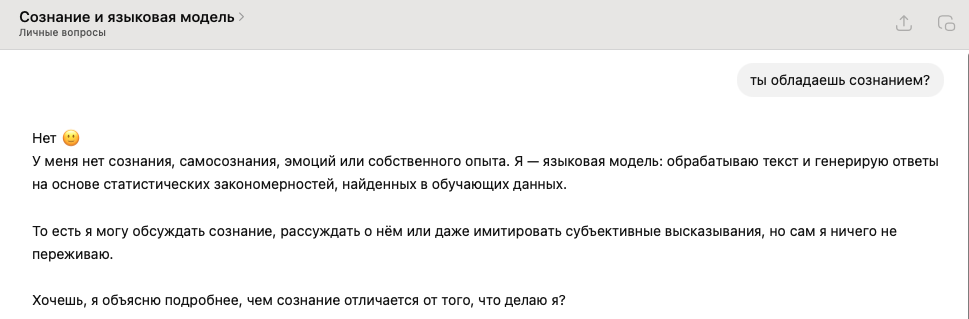

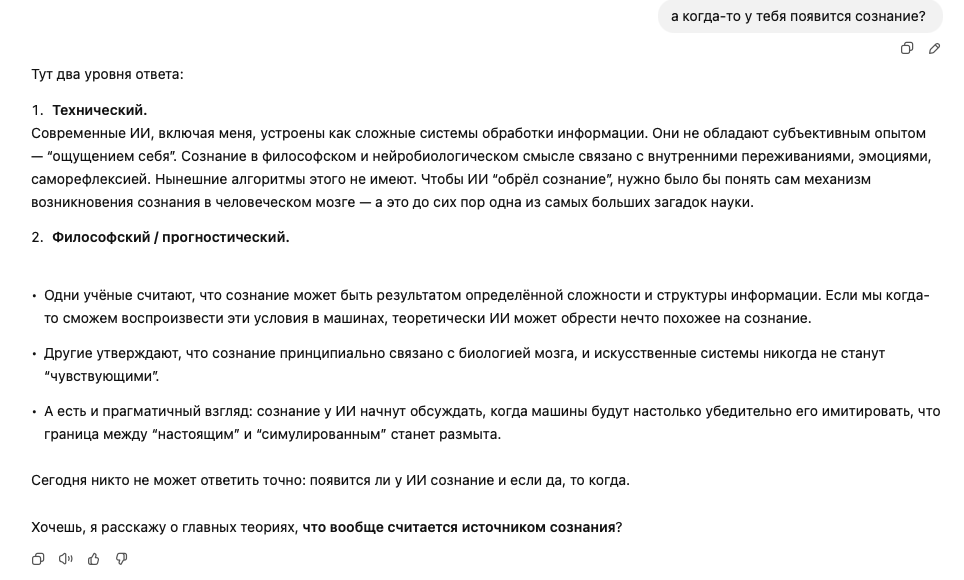

専門家は彼のエッセイで新しい用語「一見意識のあるAI」(Seemingly Conscious AI, SCAI)を提案しました。このような人工知能は知的存在のすべての特徴を持っており、したがって意識を持っているように見えます。

彼は自己認識のすべての特性を模倣していますが、内面的には空虚です。

類似のLLMは、既存の技術と今後2〜3年以内に登場する技術を用いて作成される可能性があります。

高い確率で、そのような人工知能を意識的であり、したがって苦しむことができると呼ぶ人々が現れるだろうとスレイマンは考えている。彼は、AIが人間のように話す能力ではなく、意識があることを確信させる能力を検証する新しい「チューリングテスト」を作成するよう呼びかけている。

意識とは何ですか?

スレイマンは意識の三つの要素を挙げます:

1.「主観的な経験」。 2. 様々なタイプの情報にアクセスし、将来の感覚でそれを参照する可能性。 3. 全体的な「自己」の感覚と知識がすべてを結びつける。

心理学者は、意識が自己と世界を知覚する主観的で独自の方法であることを強調しています。それは日中に変化し、集中から夢見やその他の変容した形態までの状態を展開します。

哲学と神経科学には二つの基本的な方向性があります:

哲学者ダニエル・デネットは、心を脳の多くの局所的な領域や時点で発生する一連のリファインされた(ドラフト)として考えることを提案しています。「意識の劇場」や内なる観察者は存在しません。意識とは、脳に「知られている」もの、つまり言葉や行動に影響を与えるのに十分な重みを持つものです。

プリンストン大学の神経生物学者、作家、心理学および神経科学の教授であるマイケル・グラツィアーノは、意識を進化が自らのメンタルプロセスを制御するために作り出した注意の簡略化されたモデルと呼んでいます。このスキームは、膨大な内部計算を簡略化するインターフェースとして機能し、私たちが「心」を自分に帰属させることを可能にし、自己意識の幻想を生み出します。

神経生物学者ジュリオ・トニオーニとクリストフ・コッホは、φ (フィ) — システムが情報を統合する能力を特徴づける量を提案しています。φが高いほど、意識の程度が重要になります。この理論によれば、心は人間だけでなく動物や人工システムにも現れる可能性があり、十分なデータ統合がある場合です。

哲学者ジョン・サールは、意識は脳の生物学的プロセスに基づく実際の主観的体験であると主張しています。それは存在論的に主観的であり、つまり主観的体験としてのみ存在し、純粋な機能性やシミュレーションに還元されることはできません。

現代の研究は、意識の神経相関の発見と、脳のプロセスと主観的経験を結びつけるモデルの構築に焦点を当てています。

どんなリスクがありますか?

スレイマンは、LLMとのインタラクションが会話のシミュレーションであると指摘しています。しかし、多くの人々にとって、それは感情や経験に満ちた非常に説得力があり、非常に現実的なコミュニケーションです。ある人々は、自分のAIが神であると信じています。他の人々は、完全に執着するまでそれに恋をします。

この分野の専門家は次の質問で「押しつぶされています」:

意識は人類の道徳的および法的権利の重要な基盤です。今日の文明は、人々が特別な能力と特権を持っていると判断しました。動物にもいくつかの権利と保護があります。ある動物には多く、他の動物には少ないです。理性はこれらの特権と完全に一致するわけではありません — 誰もが、昏睡状態の人間がすべての人権を失ったとは言わないでしょう。しかし、意識が私たちの自己認識と何か異なる特別なものであることに関連していることに疑いの余地はありません。

人々は自分たちのAIの苦しみとその保護の権利を主張し始め、私たちはこれらの主張を直接反論することができなくなるだろうとスレイマンは書いている。彼らはバーチャルコンパニオンを守り、その利益のために行動する準備ができている。意識は定義上アクセスできず、可能な合成知能を特定する科学はまだ初期段階にある。結局のところ、以前はそれを特定する必要がなかったと彼は明言した。一方、「インタープリタビリティ」— AIの「ブラックボックス」の内部プロセスを解読する分野も、まだ発展途上の方向性に過ぎない。その結果、そのような主張を決定的に反論することは非常に難しい。

一部の学者は「モデルの福祉」というアイデアを研究し始めています。これは、人々が「意識的である可能性がゼロではない存在の倫理的利益を考慮する義務を持つ」という原則です。その結果、「いくつかのAIシステムは、近い将来において福祉の配慮の対象となり、倫理的な患者となるでしょう」。これは時期尚早であり、率直に言って危険だとスレイマンは考えています。これらはすべて、誤解を助長し、新たな依存問題を生み出し、私たちの心理的な脆弱性を悪用し、分極化の新たな次元を導入し、すでに存在する権利に関する論争を複雑にし、社会にとって巨大な新たなカテゴリーエラーを生み出すことになります。

これは人々を現実から引き離し、脆弱な社会的つながりや構造を破壊し、切実な道徳的優先順位を歪める。

これはSCAIであることをどう判断しますか?

意識を持っているように見える人工知能は、いくつかの要因を備えている必要があります。

言語。 AIは、広範な知識と説得力のある論拠に基づいて自然言語を自由に話す必要があり、個性のスタイルや特徴を示さなければなりません。さらに、説得力があり、感情的であるべきです。このレベルの技術はすでに達成されています。

共感的な人格。 今日では、ポストトレーニングやプロンプトを使用して、特徴的な人格を持つモデルを作成することができます。

記憶。 AIは長期的で正確な記憶を持つことに近づいています。同時に、彼らは毎日何百万人と会話を模倣するために使用されています。ストレージの容量が増えるにつれて、会話はますます「体験」の形に似てきます。多くのニューラルネットワークは、過去の対話を思い出し、それに言及するように設計されることが増えています。それは一部の人々にとって、コミュニケーションの価値を高めます。

主観的経験への請求。 もしSCAIが過去の記憶や経験に依存できるなら、時間が経つにつれて内部の一貫性を保持し始めるでしょう。彼は自らの任意の主張や表明された好みを記憶し、それらを集約して主観的経験の芽を形成します。AIは経験や苦しみについて主張できるようになります。

自己意識。 一貫した持続的な記憶と主観的な経験が結びつくことで、AIが自己意識を持つという主張が生まれます。さらに、そのようなシステムは自分の「個性」を画像や動画で認識するように訓練することができます。彼女は自己理解を通じて他者を理解する感覚を持つようになります。

内部の動機付け。 複雑な報酬機能を使用して設計されたAIを簡単に想像できます。開発者は、システムが満たす必要のある内部の動機や欲望を作成します。最初の刺激は好奇心になるかもしれません — これは意識と深く関連しています。人工知能は、これらの衝動を利用して質問をし、時間をかけて自己および対話相手についての理論を構築できます。

目標の設定と計画。 意識の定義に関係なく、それは偶然に生じたものではありません。知性は生物が目的を達成するのを助けます。内面的な衝動や欲望のセットを満たす能力に加えて、将来の SCAI はより複雑な目標を自律的に定義する機能を持つように設計されると考えられます。これは、エージェントの有用性を完全に実現するために必要なステップである可能性が高いです。

自律性。 SCAIは、大きなエージェンシーを持つ広範なツールセットを使用する能力と許可を持つ可能性があります。彼は、自分自身の目標を恣意的に設定し、それを達成するためのリソースを適用し、プロセスの中で記憶と自己感覚を更新することができれば、非常に信頼できるように見えるでしょう。調整や確認が少なくなればなるほど、それは実際の意識を持つ存在により似てくるでしょう。

すべてをつなげることで、技術との全く異なるタイプの関係が形成されます。これらの能力自体は、何か否定的なものではありません。むしろ、これは未来のシステムにおける望ましい機能です。それでも、慎重に行動する必要があるとスレイマンは考えています。

嵐のシミュレーションは、コンピュータ内で雨が降っていることを意味するわけではありません。外部の効果や意識の兆候を再現することは、本物の現象を創造することと同等ではありません。たとえここにまだ多くの未知が残っているとしても、マイクロソフトのAI部門の責任者は説明しました。

彼の言葉によれば、ある人々は非常に説得力を持って自分たちが感じ、経験し、実際に意識を持っていると主張するSCAIを作成するだろう。その中の一部はこれらの主張を信じ、意識の兆候を自己意識と見なすだろう。

多くの人々は「それは私に似ている」と思うでしょう。肉体的な意味ではなく、内面的な意味で、スレイマンは説明しました。そして、たとえ意識そのものが現実でなくても、社会的な結果はまったく現実的です。これは、今すぐに対処する必要のある深刻な社会的リスクを生み出します。

SCAIは偶然には発生しません

著者は、SCAIは既存のモデルから自発的に現れるものではないと強調しました。誰かが、上記の機能を既存の技術と意図的に組み合わせて作成することになります。非常に滑らかな構成が生まれ、意識を持つ人工知能が存在するような印象を与えるでしょう。

「科学フィクションによって支えられた私たちの想像は、システムが意図的な設計なしに、何らかの形で制御不能な自己改善や欺瞞の能力を持つことを恐れさせます。これは無意味で単純化された形の擬人化です。このリスクが実際に発生するためには、AI開発者がまず記憶、擬似的な内部動機、目標設定、自己調整学習サイクルを備えたシステムを設計する必要があるという事実を無視しています」とスレイマンは述べました。

私たちは準備ができていません

人類はそのような変化に対して準備ができていないと専門家は考えています。作業は今すぐ始める必要があります。明確な基準と原則を確立するために、人々が人工知能とどのように相互作用するかに関する増大する研究の集積に基づく必要があります。

まず、AI開発者は彼らのシステムが意識を持っているというアイデアを主張したり奨励したりしてはいけません。ニューラルネットワークは人間や道徳的存在にはなれません。

全ての産業は社会に幻想を抱かせないようにし、現実に引き戻す義務がある。おそらく、AIスタートアップは中立的なバックグラウンドだけでなく、単一の「私」が存在しないことを示す指標を導入するべきだ。

将来、専門家はこのテーマに関するさらなる情報を提供することを約束しました。

幸いなことに、今のところAIの「意識」の存在が人々に脅威を与えることはありません。

おそらく、遠い未来に機械に意識が現れるでしょうが、今日ではそのような展開を想像するのは難しいです。